In het snel evoluerende landschap van kunstmatige intelligentie is het een van de grootste uitdagingen om AI-modellen effectief te laten samenwerken met externe tools, gegevensbronnen en API’s. Het Model Context Protocol (MCP) en zijn serverimplementaties zijn naar voren gekomen als een baanbrekende oplossing voor dit probleem. Het Model Context Protocol (MCP) en zijn serverimplementaties zijn naar voren gekomen als een baanbrekende oplossing voor dit probleem. Deze blog onderzoekt MCP-servers, hun architectuur, functionaliteit en de cruciale rol die ze spelen in het verbeteren van AI-mogelijkheden.

Wat is een MCP-server?

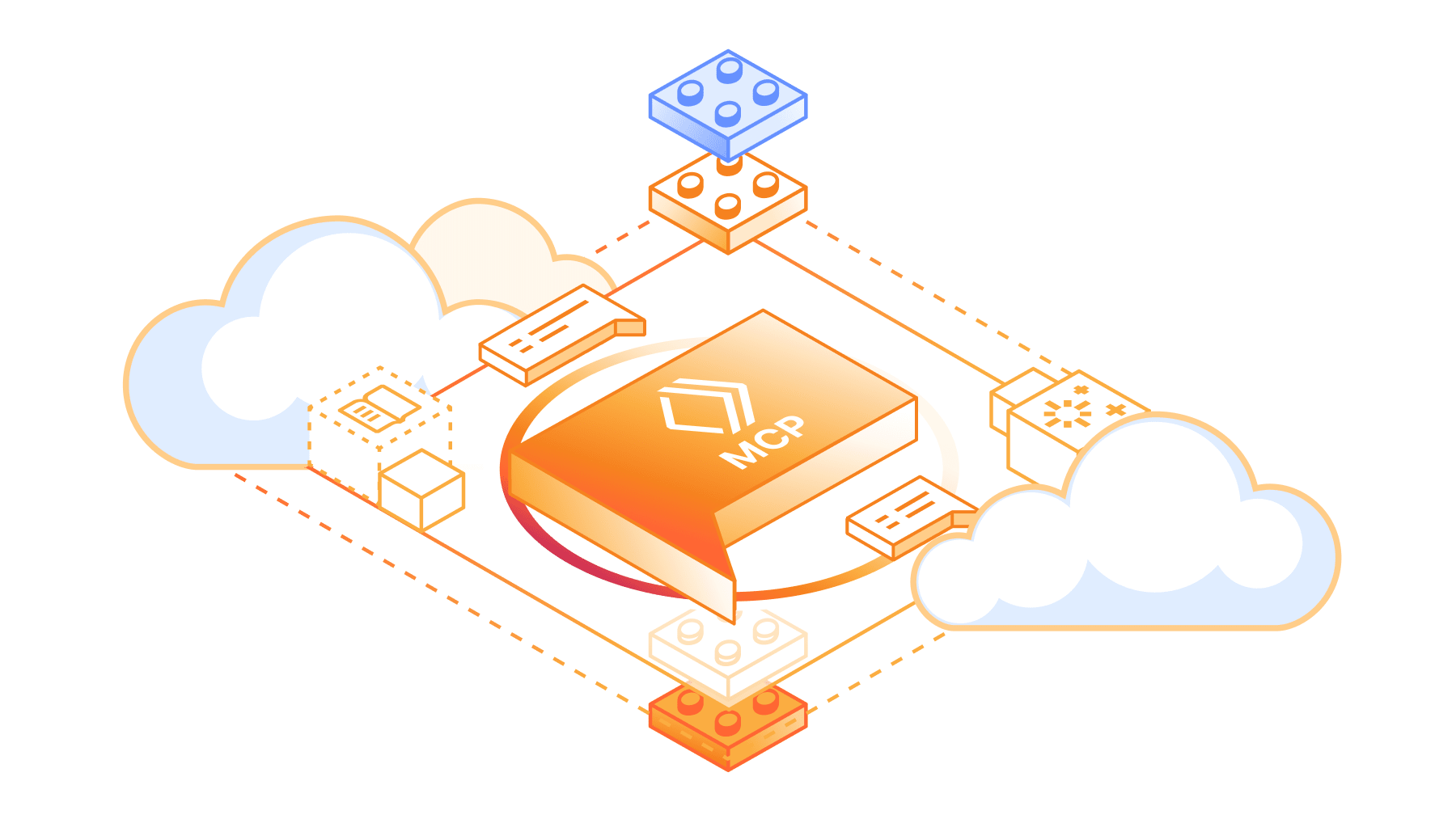

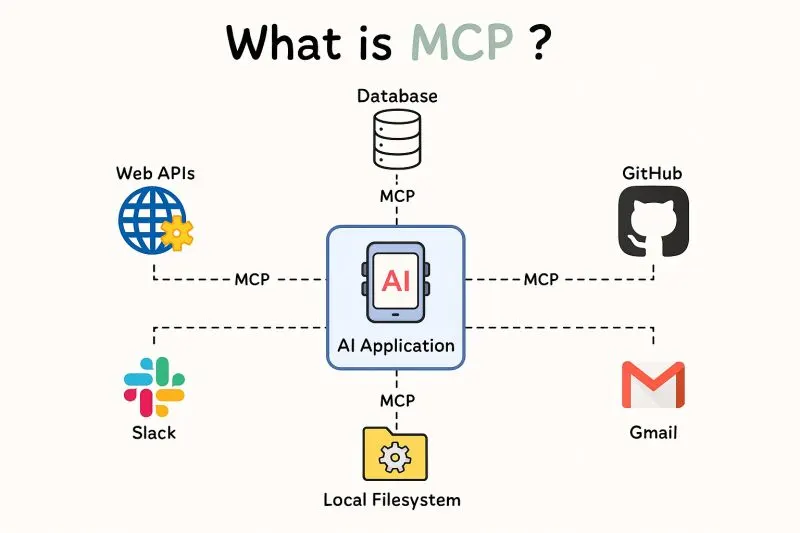

Een MCP-server, of Model Context Protocol-server, is een cruciaal onderdeel van de Model Context Protocol-standaard die ontworpen is om naadloze communicatie tussen generatieve AI-toepassingen en bedrijfsgegevens of AI-tools te vergemakkelijken. Zie MCP als een “universele USB-C connector voor AI”, die standaardiseert hoe taalmodellen communiceren met verschillende gegevensbronnen en externe systemen.

MCP-servers halen gegevens op uit backendbronnen, waarbij elke bron zijn eigen methode voor gegevenstoegang kan hebben. Ze kunnen transacties van een gebruiker ophalen uit meerdere SQL-databases, documenten uit bestandsopslag, wisselkoersen uit een API of feiten uit een kennisbank. Deze mogelijkheid pakt de fundamentele uitdaging aan van het beheren van enorme hoeveelheden gegevens die verspreid zijn over verschillende silo’s binnen bedrijfsomgevingen.

De behoefte aan MCP-servers komt voort uit de schaalbare knelpunten die ontstaan wanneer AI-systemen aangepaste integratie vereisen met elke nieuwe gegevensbron. Door een standaardprotocol te bieden, zorgen MCP-servers ervoor dat grote taalmodellen (LLM’s) de juiste gegevens op het juiste moment krijgen, waardoor de kans op AI-hallucinaties en andere fouten aanzienlijk afneemt.

MCP-architectuurcomponenten

De MCP-architectuur bestaat uit verschillende onderling verbonden componenten die samenwerken om naadloze integratie mogelijk te maken:

MCP Hosts

Dit zijn applicaties zoals Claude Desktop of AI-gedreven IDE’s die toegang nodig hebben tot externe gegevens of tools. In de MCP-architectuur fungeert het AI-model (bv. Azure OpenAI GPT) dat gegevens of acties opvraagt als host.

MCP Clients

Clients onderhouden speciale, één-op-één verbindingen met MCP-servers. Ze fungeren als intermediaire diensten die de verzoeken van het AI-model doorsturen naar de juiste MCP-servers.

MCP-servers

Dit zijn lichtgewicht servers die specifieke functionaliteiten beschikbaar stellen via MCP, door verbinding te maken met lokale of externe gegevensbronnen. Ze fungeren als applicaties die specifieke mogelijkheden bieden, zoals API’s, databases of bestandstoegang.

Gegevensbronnen

De architectuur bevat zowel lokale gegevensbronnen (bestanden, databases of diensten die veilig toegankelijk zijn via MCP-servers) als externe diensten (externe internetgebaseerde API’s of diensten). Deze vertegenwoordigen verschillende backendsystemen, waaronder lokale opslag, clouddatabases en externe API’s.

Deze scheiding van belangen maakt MCP-servers zeer modulair en onderhoudbaar, waardoor flexibele integratie met verschillende systemen mogelijk is.

Hoe MCP-servers werken

Om te begrijpen hoe MCP-servers in de praktijk werken, kun je het volgende voorbeeld bekijken: Je gebruikt een met AI verbeterde IDE zoals Cursor (een MCP host) om een projectbudget te beheren. Wanneer je een budgetrapport moet bijwerken in Google Sheets en je team een samenvatting moet sturen via Slack, werkt het proces als volgt:

- Cursor (MCP-host) verzoekt zijn MCP-client om het budgetrapport bij te werken en een notificatie te sturen.

- De MCP-client maakt verbinding met twee MCP-servers: één voor Google Sheets en één voor Slack.

- De Google Sheets MCP-server interageert met de Google Sheets API om het budgetrapport bij te werken.

- De Slack MCP-server werkt met de Slack API om een melding te versturen.

- MCP-servers sturen antwoorden terug naar de MCP-client.

- De MCP-client stuurt deze reacties door naar Cursor, die het resultaat weergeeft aan de gebruiker.

Deze workflow laat zien hoe MCP-servers de datacommunicatie tussen AI-modellen en bronsystemen beheren, waarbij conversational latency wordt geïmplementeerd die onmiddellijke reactietijden garandeert die cruciaal zijn voor gebruikersinteracties.

Voordelen van MCP-servers

De implementatie van MCP-servers biedt verschillende belangrijke voordelen voor AI-systemen:

Gestandaardiseerde communicatie

MCP biedt een gestructureerde manier voor AI-modellen om te communiceren met verschillende tools, waardoor een gemeenschappelijke taal ontstaat voor AI-gegevenscommunicatie.

Realtime gegevenstoegang

MCP-servers stroomlijnen het proces van toegang tot nieuwe gegevens vanuit bronsystemen, waardoor realtime reacties worden gegarandeerd en hoge prestaties worden behouden.

Verbeterde beveiliging en privacy

MCP-servers leggen de nadruk op privacy en beveiliging om te voorkomen dat gevoelige gegevens weglekken naar AI-modellen. Dit zorgt ervoor dat de regelgeving voor gegevensbescherming wordt nageleefd, waardoor zowel de onderneming als haar klanten worden beschermd.

Toegang tot tools en uitbreiding

AI-assistenten kunnen externe tools gebruiken voor realtime inzichten, waardoor hun mogelijkheden aanzienlijk worden uitgebreid, buiten hun ingebouwde kennis om.

Multi-Modale Integratie

MCP ondersteunt verschillende communicatiemethoden, waaronder STDIO, Server-Sent Events (SSE) en WebSocket, waardoor flexibele implementatiebenaderingen mogelijk zijn.

Beveiligingsoverwegingen voor MCP implementaties

Hoewel MCP-servers enorme voordelen bieden, introduceren ze ook beveiligingsuitdagingen die moeten worden aangepakt:

Authenticatie-uitdagingen

Vóór 26 april 2025 ging de MCP-specificatie ervan uit dat ontwikkelaars hun eigen authenticatieserver zouden schrijven, waarvoor kennis van OAuth en gerelateerde beveiligingsbeperkingen vereist was. Recente updates staan MCP-servers toe om gebruikersauthenticatie te delegeren aan externe services zoals Microsoft Entra ID.

Permissiebeheer

Een belangrijk beveiligingsprobleem is het voorkomen dat MCP-servers buitensporige machtigingen hebben voor de services/bronnen waartoe ze toegang hebben. Volgens het principe van least privilege mag geen enkele resource meer rechten hebben dan nodig is voor de beoogde taken. Dit is vooral een uitdaging bij AI, omdat het definiëren van exacte toestemmingsvereisten moeilijk kan zijn, terwijl de flexibiliteit behouden moet blijven.

Mitigatiestrategieën

Beveiligingsexperts raden aan om de autorisatielogica van MCP-servers grondig te herzien, best practices voor tokenvalidatie en -levensduur te implementeren en veilige tokenopslag met encryptie te gebruiken. In het Digital Defense Report van Microsoft wordt opgemerkt dat 98% van de gerapporteerde inbreuken zou kunnen worden voorkomen door robuuste beveiligingshygiëne, veilige codeerpraktijken en beveiliging van de toeleveringsketen.

Prestatie-evaluatie van MCP-servers

Recente evaluaties hebben aanzienlijke variaties in de prestaties van verschillende MCP-serverimplementaties aan het licht gebracht:

Effectiviteit en efficiëntie

Bij webzoektaken vertonen MCP-servers aanzienlijke verschillen in effectiviteit, met nauwkeurigheidspercentages variërend van slechts 13,62% (DuckDuckGo Search Server) tot wel 64,33% (Bing Web Search).

Tijdverbruik

Efficiëntiecijfers variëren ook dramatisch, met reactietijden variërend van minder dan 15 seconden (Bing Web Search, Brave Search) tot meer dan 230 seconden (Exa Search) voor geldige voorbeelden.

Tokengebruik

Tokenconsumptiepatronen zijn relatief consistent tussen verschillende MCP-serverimplementaties, over het algemeen tussen de 150-250 tokens, wat aangeeft dat modellen beknopte antwoorden geven zonder onnodig uit te weiden over hun MCP-gebruik.

Vergelijking met functie-oproepen

Onderzoek suggereert dat het gebruik van MCP’s niet altijd een merkbare verbetering oplevert in vergelijking met functie-oproepen, wat aangeeft dat de kwaliteit van de implementatie de prestaties aanzienlijk beïnvloedt.

Uw eigen MCP-server bouwen

Voor ontwikkelaars die een MCP-server willen implementeren, zijn er twee primaire benaderingen:

- De Python SDK gebruiken

- De JavaScript SDK gebruiken

De Python SDK biedt een eenvoudiger implementatietraject voor beginners. Bij het bouwen van een MCP-server moeten ontwikkelaars rekening houden met:

- Welke gegevensbronnen toegankelijk moeten zijn

- Authenticatie- en beveiligingsvereisten

- Vereisten voor optimalisatie van prestaties

- Integratiepunten met bestaande systemen

Ongeacht de aanpak, blijft een juiste implementatie van beveiligingscontroles en naleving van best practices essentieel voor het maken van robuuste, veilige MCP-servers.

Toekomst van MCP in AI-integratie

Aangezien de MCP-specificatie snel blijft evolueren, zullen verschillende ontwikkelingen de toekomst ervan waarschijnlijk vormgeven:

Verbeterde beveiligingsintegratie

De beveiligingscontroles binnen de MCP-specificatie zullen naar verwachting volwassener worden, waardoor een betere integratie met bedrijfs- en gevestigde beveiligingsarchitecturen en best practices mogelijk wordt.

Optimalisatietechnieken

Onderzoek suggereert dat de effectiviteit van MCP-servers kan worden verbeterd door de parameters te optimaliseren die door de LLM moeten worden geconstrueerd. Deze aanpak zou de prestatiecijfers van verschillende implementaties aanzienlijk kunnen verbeteren.

Standaardisatie en interoperabiliteit

Naarmate meer organisaties overstappen op MCP, kunnen we een grotere standaardisatie en interoperabiliteit tussen verschillende implementaties verwachten, waardoor integratieproblemen worden verminderd en de algehele betrouwbaarheid van het systeem wordt verbeterd.

MCP-servers vormen een cruciale ontwikkeling in het AI-landschap en pakken de kritieke uitdaging aan om AI-modellen te verbinden met het enorme ecosysteem van gegevensbronnen en tools waar bedrijven op vertrouwen. Door een gestandaardiseerd communicatieraamwerk te bieden, maken MCP-servers krachtigere, nauwkeurigere en responsievere AI-toepassingen mogelijk met behoud van beveiliging en prestaties.

Naarmate het protocol volwassener wordt, moeten organisaties die AI-oplossingen implementeren de ontwikkelingen op dit gebied op de voet volgen en overwegen hoe MCP-servers hun AI-integratiestrategieën kunnen verbeteren. De mogelijkheid om AI-modellen naadloos te verbinden met bedrijfsgegevens zal steeds meer een onderscheidende factor worden voor de concurrentie, waardoor MCP-servers een essentieel onderdeel vormen van een moderne AI-architectuur.

Hoewel er nog uitdagingen zijn, met name op het gebied van beveiliging en prestatieoptimalisatie, suggereert het ontwikkelingstraject van MCP een veelbelovende toekomst voor deze technologie als fundamenteel element in de volgende generatie AI-toepassingen.